-

@ThothChildren

@ThothChildren

- 2018.1.9

- PV 234

WGAN

ー 概要 ー

正式名はWasserstein GAN.GANの学習の不安定さを数学的に改善した。WGANを改良したWGAN-GPが近年用いられることが多い。

この章を学ぶ前に必要な知識

条件

- 重みをClipする操作が必要

効果

- GANより学習が安定しやすくなる

- mode collapse問題にならない

ポイント

- WGAN-GPがこれをさらに改善

- 目的関数を改良することで安定化

- 勾配消失が起きやすいJS距離よりW距離を使うことで改善

解 説

WGANは二つの分布の距離を計算するWasserstein距離を用いることで、GANで学習が安定しなかった問題を改善することができたGANの一種。

WGANの重みのクリッピング作業には課題がありWGAN-GPの方が一般的に用いられる。 | GANとは |

WGANは元々のGANの目的関数を変更することで実現できる。

・logを誤差関数から除去

等のみ | WGAN実装 |

この章を学んで新たに学べる

Comments

Reasons

知識: GANとは

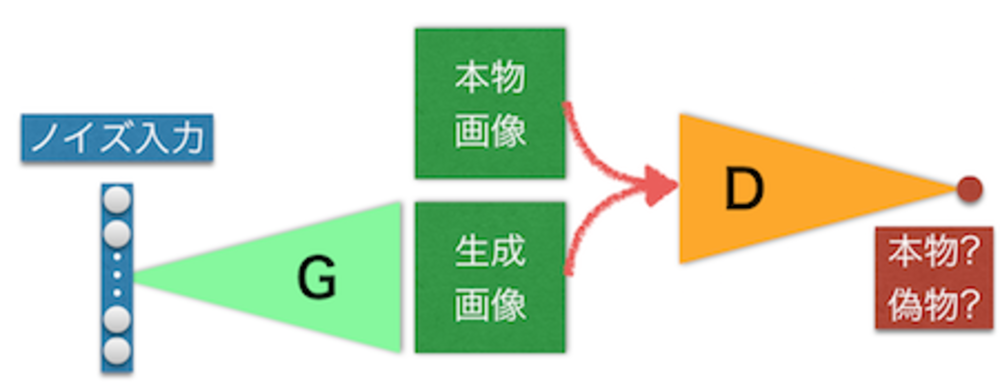

近年注目されている画像等を生成するニューラルネットワークを用いた学習手法.二つのニューラルネットワークを使って片方の識別能力をあげる点が特徴.既にGANの改良系が数十種類提案されている.